Hadoop深入学习:再谈MapReduce作业提交和执行

在本章中,我们将来重温一下和Hadoop的作业提交和执行流程。

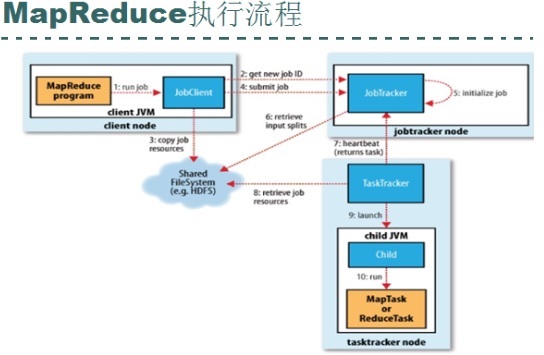

看下图,我们来比较详细的学习一下该流程:

1、 编写MapReduce job程序,通过命令行向Hadoop提交并开始执行作业:引用

# hadoop fs -put xxx.jar /path //或者使用hadoop fs -copyFromLocal xxx.jar /path 向copy文件

# chown -R hadoop xxx.jar

# chgrp -R hadoop xxx.jar

# hadoop jar xxx.jar package.ClassName input_path output_path

客户端实际上是通过JobClient的submitJobInternal提交作业的。

2、本次运行,NameNode节点会首先检查用户权限和提交参数是否正确,通过后生成一个job,于是JobClient向JobTracker申请一个JobID用于标识这个job;

3、JobClient将Job所需要的资源提交到HDFS中一个以JobID命名的目录中,这些资源包括Jar包、配置文件、InputSplit元数据信息等;

4、JobClient向JobTracker提交这个Job;

5、JobTracker初始化这个Job;

6、JobTracker通过JobID从HDFS获取这个Job的Split等信息;

7、JobTracker通过heartbeat心跳回复给TaskNode节点分配Map Task和Reduce Task;

8、TaskNode会根据分配给自己的任务到HDFS中获取相关的资源;

9、TaskNode启动分配给自己的任务;

10、开始执行Mapper或Reducer Task。